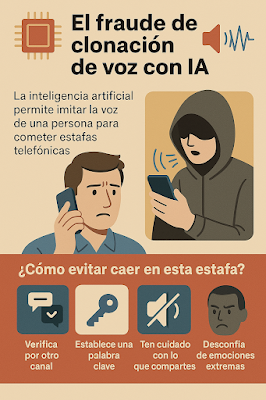

La inteligencia artificial (IA) ha traído avances impresionantes, pero también ha abierto la puerta a nuevas formas de fraude. Una de las más preocupantes es la clonación de voz, una técnica que utiliza IA para imitar la voz de una persona con sorprendente precisión. Este tipo de fraude está en aumento y puede ser muy difícil de detectar. A continuación, te explicamos cómo funciona y, lo más importante, cómo puedes protegerte.

¿Qué es la clonación de voz con IA?

La clonación de voz es un proceso en el que una IA analiza grabaciones de voz para crear una réplica digital. Con solo unos segundos de audio, los estafadores pueden generar una voz artificial que suena casi idéntica a la original. Esta tecnología ha sido usada en intentos de fraude donde los delincuentes llaman a familiares o empleados, haciéndose pasar por alguien cercano, para pedir dinero u obtener información sensible.

¿Cómo se usa en fraudes?

Un ejemplo común es cuando un estafador llama a un padre o madre haciéndose pasar por su hijo con una voz clonada: “¡Mamá, estoy en problemas, necesito dinero urgente!”. En empresas, también se han visto casos donde se hacen pasar por directivos para ordenar transferencias bancarias.

¿Cómo evitar caer en este tipo de estafas?

Aquí te dejamos algunas recomendaciones prácticas:

1. Verifica siempre por otro canal

Ante una solicitud urgente o sospechosa, confirma la identidad de la persona por otro medio: mensaje de texto, videollamada o una llamada al número habitual.

2. Establece palabras clave o códigos familiares

Crea con tu familia o equipo de trabajo una palabra clave secreta que puedan usar para confirmar que están hablando con la persona real.

3. Ten cuidado con lo que compartes

Evita subir audios o videos con tu voz en redes públicas. Cuanto más material haya disponible, más fácil es para los delincuentes crear una clonación precisa.

4. Desconfía de las emociones extremas

Los estafadores suelen usar el miedo o la urgencia para presionarte. Tómate un momento para pensar antes de actuar.

5. Actualiza y protege tus dispositivos

Mantén tus sistemas y aplicaciones actualizados y usa software de seguridad confiable. Algunas plataformas ya están integrando herramientas para detectar audios generados por IA.

¿Qué hacer si sospechas que fuiste víctima?

-

No transfieras dinero inmediatamente.

-

Contacta con la persona real por otra vía.

-

Reporta el incidente a las autoridades locales o a plataformas como la policía cibernética.

-

Informa a tu círculo cercano, para que también estén alertas.

La clonación de voz con IA es una amenaza real, pero con información y precaución, puedes evitar convertirte en una víctima. Estar alerta, desconfiar de situaciones inusuales y tener mecanismos de verificación son las claves para mantenerte seguro en esta era digital.